Anthropic weigerde een contract met het Amerikaanse “Department of War” omdat hun Terms of Service expliciet verbieden dat hun technologie gebruikt wordt voor:

-

Mass domestic surveillance

-

Fully autonomous weapons

Het Pentagon eist namelijk dat AI-bedrijven akkoord gaan met “any lawful use” en dus hun eigen safeguards laten vallen.

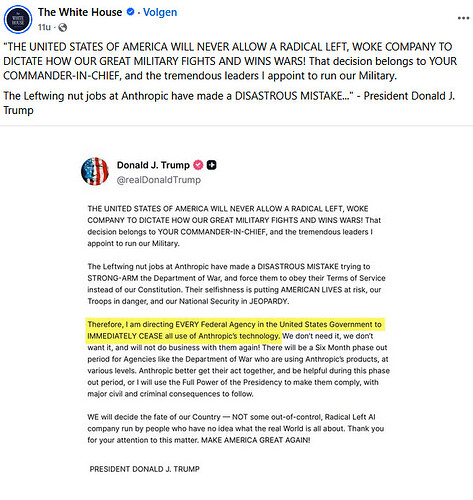

Het gevolg? Voorspelbaar… Trump reageerde furieus en beval alle federale agentschappen om “onmiddellijk” te stoppen met het gebruik van Anthropic-producten, met een uitfaseringsperiode van 6 maanden.

Dit roept voor mij een interessante vraag op die ons allemaal aangaat:

We klagen regelmatig over bedrijven zoals Meta die hun ToS gebruiken om dingen te doen die wij onethisch vinden (of zeg maar onethisch zijn ![]() ). Maar hier is het omgekeerde: een bedrijf dat via zijn ToS net strengere grenzen stelt dan de wet vereist.

). Maar hier is het omgekeerde: een bedrijf dat via zijn ToS net strengere grenzen stelt dan de wet vereist.

Dus de vraag:

Wie moet bepalen wat wel en niet mag met (AI-)technologie?

- ToS mag strenger zijn dan de wet — bedrijven mogen zelf ethische grenzen stellen

- Alleen de wet telt — ToS mag wetgeving niet overstijgen of blokkeren

- Afhankelijk van de context — voor militair gebruik andere regels dan voor consumenten

- Er moet specifieke (AI-)wetgeving komen — ToS is te willekeurig als enige bescherming

- Geen mening / te complex om zo te beantwoorden